生成式人工智能对个人信息保护的挑战与治理路径

作者:万美秀

发布日期:2024-05-07

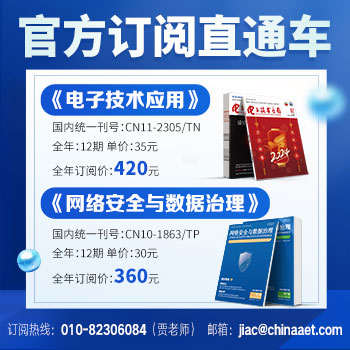

来源:网络安全与数据治理